Po co w ogóle domowy serwer? Definicja, scenariusze, granice sensu

Co wiemy o potrzebach, a czego jeszcze nie?

Domowy serwer to po prostu komputer działający 24/7, który świadczy usługi dla domowników: przechowuje dane, udostępnia multimedia, uruchamia kontenery z aplikacjami i, coraz częściej, obsługuje modele AI. Kluczowe pytanie brzmi: co chcesz na nim robić regularnie, a co jest tylko jednorazową zachcianką? Od tej odpowiedzi zależy, ile wydasz na sprzęt i prąd.

Najczęściej powtarzające się potrzeby to:

- bezpieczny domowy serwer na backup zdjęć, dokumentów, projektów

- tani serwer do multimediów – filmy, muzyka, seriale w sieci lokalnej

- platforma pod kontenery, testy i serwer pod eksperymenty z AI

- lekkie usługi sieciowe: VPN, DNS, monitoring, małe aplikacje webowe

Czego zwykle jeszcze nie wiemy na starcie? Rzeczy pozornie drugorzędnych: hałas, zużycie energii, czas na administrację. Wiele osób zaczyna na starym desktopie „żeby tylko spróbować”, a kończy z głośną maszyną, która pożera kilkadziesiąt złotych miesięcznie w rachunku za prąd. Warto więc zadać sobie kilka prostych pytań kontrolnych: ile godzin dziennie realnie korzystasz z domowych multimediów? Jak często będziesz trenować modele AI? Czy ktoś w rodzinie w ogóle ma czas i chęć administrować takim serwerem?

Główne zastosowania: backup, multimedia, eksperymenty z AI

Backup to najbardziej oczywisty scenariusz. Domowe serwery zwykle przechowują:

- zdjęcia rodzinne i wideo z telefonów

- dokumenty, skany, projekty z pracy i studiów

- konfiguracje z innych maszyn (np. repozytorium Git, kopie maszyn wirtualnych)

Serwer dla samego backupu może być skromny: energooszczędny CPU, 4–8 GB RAM, kilka pojemnych HDD. Kluczowy staje się schemat kopii zapasowych, a nie moc obliczeniowa.

Multimedia to kolejny typowy powód budowy domowego serwera. W praktyce chodzi o:

- strumieniowanie filmów Full HD / 4K do TV, laptopów, tabletów (np. przez Jellyfin lub Plex)

- serwer muzyki (np. navidrome, Logitech Media Server)

- udostępnianie zdjęć rodzinie (np. Photoprism, Immich)

Tu pojawia się kwestia transkodowania (konwersji w locie). Jeśli Twoje klienty (TV, odtwarzacze) obsługują natywnie format, w jakim trzymasz filmy, CPU może być słaby. Jeśli serwer musi masowo transkodować, wymagania rosną skokowo.

Eksperymenty z AI to najszybciej rosnąca kategoria. Na domowym serwerze możesz:

- uruchamiać lokalne modele językowe (LLM) w stylu LLaMA, Mistral, Qwen

- bawić się rozpoznawaniem obrazu (stable diffusion, narzędzia OCR, detekcja obiektów)

- testować pipeline’y MLOps, automatyzować analizy danych

W tej kategorii karta graficzna i ilość RAM zaczynają być krytyczne, ale nie zawsze. Proste modele w wersjach skompresowanych (quantized) potrafią działać wydajnie na samym CPU i 16 GB RAM. Część użytkowników przecenia swoje potrzeby, kupując mocne GPU, które w praktyce pracuje kilka godzin w miesiącu, a resztę czasu bez sensu zużywa prąd w idlu.

Kiedy domowy serwer ma sens, a kiedy lepsza jest chmura lub gotowy NAS

Domowy serwer ma sens, gdy:

- przechowujesz dużo danych (kilka–kilkanaście TB) i chmura zaczyna być droższa niż prąd + sprzęt

- potrzebujesz pełnej kontroli nad danymi (np. dane wrażliwe, RODO, materiały firmowe)

- lubisz majsterkować i rozwijać własne środowisko IT

- chcesz mieć low power home server, który można dopasować do swoich scenariuszy

Chmura bywa lepsza, kiedy:

- zabezpieczasz jedynie kilka–kilkanaście GB ważnych dokumentów i zdjęć

- nie masz czasu ani kompetencji, by dbać o bezpieczeństwo i aktualizacje

- multimedia odtwarzasz głównie przez serwisy VOD, a nie z własnej biblioteki

Gotowy NAS (Synology, QNAP) to rozwiązanie pośrodku: mniejsze możliwości rozbudowy, ale prostota konfiguracji, gotowe aplikacje, mały pobór prądu. Sprawdza się w rodzinach, gdzie jedna osoba administruje, a reszta po prostu korzysta. Do intensywnych testów AI i wirtualizacji zwykle brakuje mu jednak mocy i elastyczności.

Ograniczenia: prąd, hałas, miejsce, czas na administrację

Największym wrogiem taniego serwera domowego jest zużycie energii w spoczynku. Maszyna, która działa 24/7, nawet przy 20–30 W różnicy potrafi w rok wygenerować zauważalny koszt. Podstawowy cel: zbudować konfigurację, która w idle zużywa jak najmniej, a przy obciążeniu potrafi „dostarczyć” tyle, ile faktycznie trzeba.

Druga kwestia to hałas. Serwer, który stoi w salonie czy sypialni, nie może zachowywać się jak „odkurzacz w szafce”. Hałas generują nie tylko wentylatory, ale i talerzowe HDD. Im bardziej pojemne i szybsze dyski, tym częściej usłyszysz ich pracę.

Dochodzi jeszcze miejsce – w małym mieszkaniu nie postawisz pełnowymiarowej obudowy tower z ośmioma HDD. Dlatego coraz częściej wygrywają mini PC i terminale thin client, które można schować za TV albo do szafki.

Ostatni element to czas. System bez aktualizacji, bez sprawdzania logów i bez przeglądu stanu dysków prędzej czy później sprawi kłopot. Przy założeniu, że nikt w domu nie jest pełnoetatowym administratorem, konfiguracja musi być możliwie prosta.

Typowe „profile” użytkowników domowego serwera

Da się wyróżnić kilka powtarzalnych scenariuszy budowy domowego serwera:

- Rodzina – głównie backup zdjęć i dokumentów, kilka TB danych, serwer multimediów dla TV, mało eksperymentów technicznych.

- Hobbysta IT – dużo kontenerów, Proxmox, testy systemów, automatyzacja, drobne projekty AI, kilka–kilkanaście usług sieciowych.

- Mała firma w domu – serwer plików, kopie zapasowe stacji roboczych, czasem małe aplikacje biznesowe, wyższe wymagania co do niezawodności.

Wymagania i budżet – jak nie przestrzelić ani w dół, ani w górę

Priorytety: cena, prąd, wydajność, cisza

Domowy serwer to kompromis między czterema parametrami:

- cena – ile chcesz wydać na start

- konsumpcja energii serwera – ile będziesz płacić co miesiąc

- wydajność – czy obciążenia nie „zamordują” sprzętu

- cisza – czy serwer nie będzie przeszkadzał w codziennym życiu

Plan jest prosty: dobrać minimalny sprzęt, który bez zadyszki obsłuży Twoje scenariusze i pozostawi niewielki zapas. Zbyt słaby serwer zniechęci do używania, zbyt mocny – będzie bez sensu zużywał prąd.

Jak przełożyć zastosowania na wymagania sprzętowe

Główne komponenty, które wpływają na odczuwalną pracę serwera domowego:

Na koniec warto zerknąć również na: Dysk twardy MAMR 40 TB w NAS 2-zatokowym – test WD Ultrastar DC HC680 — to dobre domknięcie tematu.

- CPU – decyduje o wydajności transkodowania, kontenerów, usług bazodanowych i części zadań AI

- RAM – ilu usług jednocześnie możesz użyć, w jakim rozmiarze będą cache i buffery

- dyski – pojemność i rodzaj (HDD, SSD, NVMe) determinują szybkość odczytu/zapisu i czas reakcji

- sieć – przepustowość (1 GbE vs 2.5/10 GbE) oraz jakość karty sieciowej

- GPU – konieczne przy wydajniejszych zastosowaniach AI i czasem do akceleracji transkodowania

Dla samego backupu plików i prostego NAS w zupełności wystarczy:

- 2–4 rdzeniowy CPU klasy laptopowej (np. i3, Pentium Gold, Ryzen 3/5 U)

- 4–8 GB RAM

- 1–2 dyski HDD 4–8 TB w RAID1 lub bez RAID + kopia zewnętrzna

Dla multimediów z potencjalnym transkodowaniem:

- 4–6 rdzeniowy CPU (np. nowsze i3/i5, Ryzen 5, Atom C3000 w NAS-ach)

- 8–16 GB RAM

- minimum SSD na system + HDD na dane

- opcjonalnie sprzętowe wsparcie kodeków (Quick Sync, NVENC)

Dla eksperymentów z AI:

- 6–8 rdzeniowy CPU z rozsądnym TDP (np. Ryzen 5 5600, i5 10–12 gen.)

- 16–32 GB RAM (więcej przy wielu kontenerach i VM)

- decent GPU z 6–12 GB VRAM, jeśli planujesz modele większe niż „mini”

Realne budżety: „ultra budżet”, „złoty środek”, „hobbystyczne laboratorium”

Na rynku wtórnym i w segmencie mini PC można zbudować kilka sensownych scenariuszy finansowych.

- Ultra budżet – używany terminal thin client lub mały desktop z procesorem pokroju Intel i3 4. generacji, 8 GB RAM, jeden–dwa HDD + mały SSD na system. Wystarczy na domowy serwer na backup i prosty serwer plików.

- Złoty środek – nowszy mini PC/NUC lub używany komputer biurowy z i5/Ryzen 5, 16 GB RAM, SSD + 2–4 HDD. Tu spokojnie uruchomisz Dockera, media serwer i pierwsze narzędzia AI.

- Hobbystyczne laboratorium – konfiguracja z dedykowaną kartą graficzną, 32 GB RAM i możliwością rozbudowy dysków, najczęściej na bazie używanego desktopa lub płyty mini-ITX w obudowie z 4–6 zatokami na dyski.

Różnice w cenie startowej są duże, ale jeszcze większe bywa potem zróżnicowanie w rachunkach za energię, co prowadzi do kolejnego aspektu.

Szacowanie kosztów energii dla różnych klas sprzętu

Żeby realnie ocenić koszty działania serwera, przydaje się proste ćwiczenie. Załóżmy konserwatywnie orientacyjny pobór mocy w spoczynku (idle) dla trzech klas sprzętu:

| Typ konfiguracji | Szacunkowy pobór w idle | Charakterystyka |

|---|---|---|

| Terminal thin client / mini PC | ~10–15 W | Mało dysków, słabszy CPU, ale wysoka efektywność energetyczna |

| Używany desktop biurowy | ~25–40 W | Więcej miejsca na dyski, wyższa moc CPU, starsza platforma |

| Desktop z GPU do AI | ~50–80 W | Dedykowana grafika, większy zasilacz, potencjalnie więcej wentylatorów |

Te kilkadziesiąt watów różnicy przez 24/7 i cały rok może przełożyć się na zaskakująco wysoki koszt. Z tego powodu część użytkowników decyduje się na dwa tryby: mały, energooszczędny serwer ciągły oraz dodatkową, „grubszą” maszynę AI włączaną tylko do konkretnej pracy.

Co kupować nowe, a co można brać używane

Nie każdy element ma sens z rynku wtórnego. Bezpieczny podział wygląda następująco:

- nowe: zasilacz (PSU), dyski na ważne dane (szczególnie SSD), ewentualnie płyta główna jeśli zależy Ci na długim wsparciu

- używane: CPU, RAM, obudowa, część kart graficznych (o ile nie pracowały latami w koparkach)

Dyski używane (zwłaszcza HDD z serwerów, tzw. „refurbished”) bywają tanie i przyjemne, ale trzeba mieć jasną świadomość ryzyka. Można ich użyć w mniej krytycznych rolach lub jako drugi poziom backupu, lecz na główny magazyn danych rodzinnych lepiej wybrać nowe nośniki.

Wybór platformy sprzętowej – od używanego desktopa po mini PC i NUC

Trzy główne podejścia do sprzętu

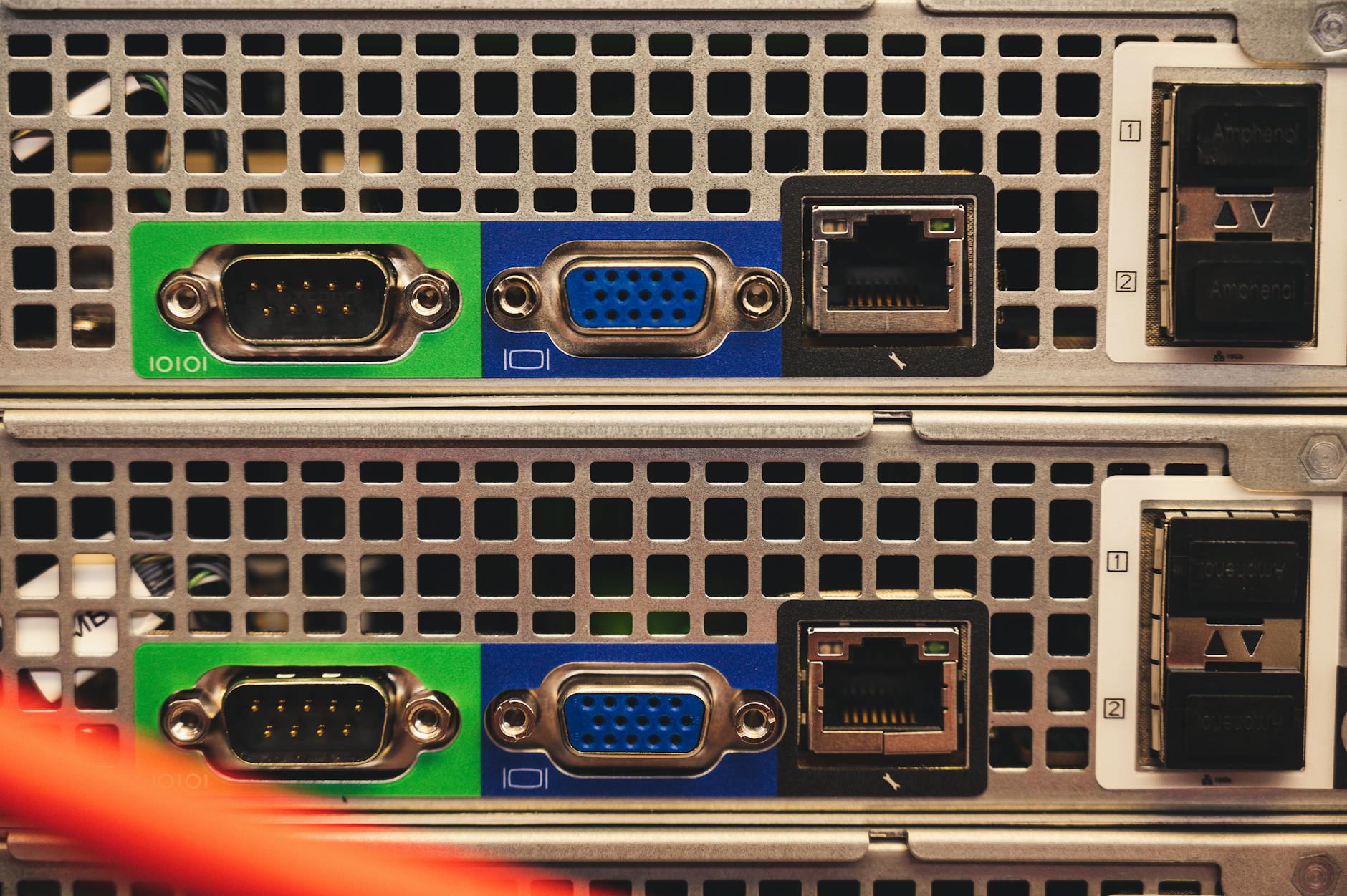

Jeśli odrzucić wyspecjalizowane obudowy rackowe i drogie NAS-y, zostają trzy główne kierunki:

- używany desktop biurowy – tanio, łatwo dostępny, często z legalnym Windows w zestawie

- mini PC / NUC – bardzo energooszczędny, mały, z reguły cichy

- terminal thin client – jeszcze tańszy i oszczędny, ale częściej ograniczony rozbudową

Różnią się nie tylko wydajnością i poborem prądu, ale też tym, jak wygodnie można w nich zamontować kilka dysków, większą ilość RAM czy GPU. Pytanie kluczowe: ile elastyczności potrzebujesz, a ile możesz poświęcić w imię prostoty i oszczędności?

Używany desktop biurowy – tani „konik roboczy”

Popularne serie typu Dell OptiPlex, HP EliteDesk czy Lenovo ThinkCentre regularnie trafiają na rynek wtórny po zakończeniu leasingu. To dobry materiał na serwer dla kogoś, kto:

- chce mieć możliwość dołożenia RAM i dysków bez kombinacji

- potrzebuje trochę więcej mocy CPU niż w mini PC

- nie boi się zużycia w idle w okolicy 30–40 W

Plusem jest sensowna jakość wykonania i łatwy dostęp do części zamiennych. Minusem – czasem bardzo specyficzne zasilacze i obudowy, które utrudniają montaż mocniejszego GPU czy większego zasilacza. W wielu modelach znajdziesz jedno–dwa miejsca na 3,5″ HDD i jeden port M.2 lub SATA na SSD, co spokojnie pokrywa potrzeby domowego NAS-a i kilku usług.

Mini PC i NUC – serwer w wersji kieszonkowej

Platformy pokroju Intel NUC, Beelink, Minisforum czy małe komputery z Ryzen U i Intel U to propozycja dla kogoś, kto:

- ma ograniczone miejsce i chce serwer schować za telewizor lub do szafki

- celuje w bardzo niski pobór prądu (10–15 W idle)

- nie planuje montażu karty graficznej pełnej wielkości

Często oferują 2 sloty RAM (maks. 32–64 GB) i przynajmniej jeden M.2 NVMe + ewentualnie miejsce na 2,5″ SSD/HDD. Do roli NAS + multimedia + lekkie eksperymenty AI w oparciu o CPU lub zewnętrzny akcelerator (np. USB Coral, NPU w nowszych CPU) to rozwiązanie wystarczające.

Ograniczenia pojawiają się przy chęci rozbudowy magazynu danych. Jeśli planujesz więcej niż 2–3 dyski, trzeba kombinować z obudowami USB, DAS-ami czy adapterami na kilka dysków NVMe, co bywa droższe niż zakup nieco większej platformy z dodatkowymi zatokami.

Terminale thin client – minimalizm z pułapkami

Sprzęt klasy HP T620/T630, Dell Wyse, Fujitsu Futro i podobne urządzenia kusi ceną oraz poborem prądu. W wielu przypadkach mają:

- niskonapięciowy CPU (często AMD G lub starsze Intel) wystarczający na NAS

- slot na 2,5″ SATA i M.2 SATA/mini PCIe

- prawie bezgłośną pracę (brak wentylatorów lub pojedynczy, wolnoobrotowy)

Ograniczenia są wyraźne: często tylko 1 slot RAM, mało miejsca w obudowie, nietypowe zasilacze. Sprawdzają się jako:

- prosty serwer backupu i plików

- maszyna pod Home Assistant, małe usługi sieciowe, DNS, VPN

- „gateway” do bardziej rozbudowanej infrastruktury

Dla eksperymentów z AI i transkodowania wideo to już rozwiązanie dość ciasne. Warto przed zakupem sprawdzić, czy CPU obsługuje w ogóle potrzebne instrukcje (np. AVX), oraz jakie są maksymalne możliwości rozbudowy RAM.

Platformy „serwerowe” w domu – kiedy to ma sens

Używane serwery 1U/2U czy tower z serii Dell PowerEdge, HP ProLiant kuszą: mają dużo zatok na dyski, kontrolery RAID, często dwa zasilacze i solidne zarządzanie zdalne (iDRAC, iLO). Problem? Hałas i zużycie energii.

W typowym mieszkaniu taka maszyna potrafi być nieakceptowalnie głośna nawet w spoczynku, a pobór mocy rzadko spada poniżej 80–100 W. Ma sens w sytuacjach granicznych:

- mini firma z biurem w domu, gdzie serwer stoi w oddzielnym pomieszczeniu

- laboratorium testowe dla osoby pracującej zawodowo z infrastrukturą

- specyficzne wymagania, np. dużo dysków SAS i 10/25 GbE

Dla typowego domu znacznie częściej wygrywa biurowy desktop lub mini PC z kilkoma dużymi dyskami.

Procesor, RAM i GPU – ile naprawdę potrzeba pod backup, multimedia i AI

CPU: więcej rdzeni czy wyższe IPC?

Przy wyborze procesora łatwo przeszacować potrzeby. Co wiemy:

- backup plików i prosty NAS prawie nie obciążają CPU – liczy się głównie dysk i sieć

- multimedia z transkodowaniem w locie potrafią „zjeść” kilka rdzeni, ale dobrze radzą sobie z akceleracją sprzętową

- eksperymenty z AI korzystają z CPU głównie wtedy, gdy nie ma sensownego GPU lub gdy modele są małe

Dla domu dobrym punktem odniesienia jest:

- 4 rdzenie / 8 wątków – dolny komfortowy poziom dla NAS + multimedia + parę kontenerów

- 6 rdzeni / 12 wątków – wygodna baza dla serwera z kilkoma VM i lekką AI

- 8 rdzeni i więcej – sens przy cięższej wirtualizacji, kompilacjach, trenowaniu mniejszych modeli na CPU

W praktyce nowszy 6-rdzeniowy Ryzen 5 potrafi być bardziej energooszczędny i wydajniejszy niż leciwy 8-rdzeniowy Xeon. W dłuższej perspektywie lepiej wypadają procesory desktopowe z ostatnich kilku generacji niż stare jednostki serwerowe.

RAM: najczęstsze wąskie gardło

Pamięć operacyjna jest tania, a jednocześnie najmocniej wpływa na komfort pracy przy wielu usługach. Minimalne sensowne progi są dość czytelne:

- 8 GB – absolutne minimum dla prostego NAS-a, kilku lekkich usług

- 16 GB – rozsądna baza dla multimediów, Dockera, jednej–dwóch VM

- 32 GB – komfort dla hobbysty z Proxmoxem, LXC, kilkoma usługami AI

Przy AI i bazach danych system szybko zaczyna „zjadać” RAM na cache. Jeśli budżet to umożliwia, warto wybrać platformę, która wspiera przynajmniej 32 GB, nawet jeśli na start włożysz 16 GB.

Typowa sytuacja z życia: mały serwer z 8 GB RAM, na którym właściciel dołożył kontenery z Home Assistant, bazę danych, Photoprismę i serwer multimediów. Sprzęt na papierze był OK, w praktyce system co chwilę przerzucał dane na swap. Jedna rozbudowa RAM z 8 do 16 GB rozwiązała problem bez wymiany CPU czy dysków.

GPU: kiedy faktycznie jest potrzebne

Karta graficzna w serwerze domowym ma dwa główne zadania:

- przyspieszyć transkodowanie multimediów (NVENC, Quick Sync, VAAPI)

- obsłużyć modele AI i obliczenia na tensorach

Do samego NAS-a i usług webowych GPU jest zbędne. W przypadku multimediów często wystarczy zintegrowana grafika w nowszym Intel/AMD, jeśli oprogramowanie (np. Jellyfin, Plex) potrafi z niej korzystać.

Dla AI sytuacja wygląda inaczej. Tu liczy się głównie VRAM i wsparcie bibliotek (CUDA, ROCm). Sensowne progi:

- 6–8 GB VRAM – modele typu LLaMA 7B w wersjach skompresowanych (GGUF, Q4–Q5), podstawowe generowanie obrazów

- 10–12 GB VRAM – wygodniejsza praca z większymi modelami, kilkoma instancjami, prostsze fine-tuning

Starsze karty NVIDIA (np. seria GTX 10xx, RTX 20xx) nadal sprawdzają się w domowych eksperymentach, o ile nie były eksploatowane w koparkach 24/7. Przy kartach AMD trzeba dokładniej sprawdzić wsparcie w stosowanych narzędziach – nie wszystkie frameworki są na tym samym poziomie co w przypadku CUDA.

Osobna maszyna do AI czy GPU w serwerze?

Opcje są dwie:

Dobrze zdefiniowany profil pozwala uniknąć przerostu formy nad treścią. Inaczej planuje się mini PC jako serwer dla rodziny, a inaczej maszynę dla kogoś, kto zawodowo interesuje się takimi tematami jak Informatyka, Nowe technologie, AI i chce mieć w domu mini-laboratorium.

- GPU w głównym serwerze – wygodnie, jedno miejsce do zarządzania, ale wyższy pobór prądu 24/7

- osobna maszyna AI – drugi komputer z GPU, uruchamiany tylko na czas pracy z modelami

Ekonomicznie często wygrywa scenariusz mieszany: mały serwer NAS + usługowy pracujący non stop oraz dodatkowy desktop z GPU, który stoi wyłączony, dopóki nie jest potrzebny do zadań AI lub intensywnego transkodowania. Z punktu widzenia rachunku za prąd oraz hałasu to kompromis uczciwszy niż ciągła praca potężnej karty w trybie jałowym.

Magazyn danych – dyski, RAID, ZFS, jak uniknąć katastrofy backupowej

HDD, SSD i NVMe – role w serwerze domowym

W domowym serwerze rzadko jest miejsce (i budżet) na same SSD o dużej pojemności. Typowy, rozsądny układ to:

- SSD / NVMe na system i cache – szybki start usług, poprawa responsywności

- HDD na dane – zdjęcia, filmy, archiwa, kopie maszyn wirtualnych

HDD 4–8 TB nadal zapewniają najlepszy stosunek ceny do pojemności. Do backupu multimediów i dużych plików w zupełności wystarczą modele 5400–5900 rpm „NAS-owe” lub klasy desktop. SSD warto przeznaczyć na:

- system operacyjny

- katalogi z kontenerami i VM (o ile nie są ogromne)

- cache (np. ZFS L2ARC, cache dla serwera multimediów)

RAID a backup – dwie różne sprawy

RAID nie jest backupem – to fakt, który regularnie wraca po każdej większej awarii. Macierz RAID (1, 5, 6, 10) ma głównie zapewnić ciągłość działania przy awarii jednego dysku. Nie ochroni przed:

- przypadkowym skasowaniem pliku

- zaszyfrowaniem danych przez ransomware

- błędem użytkownika (nadpisanie, usunięcie wolumenu)

- kradzieżą lub fizycznym zniszczeniem sprzętu

Dla domu sens ma najczęściej RAID1 (mirror) na dwóch dyskach lub RAIDZ1/RAIDZ2 w ZFS przy większej liczbie nośników. Ale nawet przy RAID2x warto mieć dodatkową kopię danych offline lub w innej lokalizacji.

ZFS, Btrfs, mdraid – co wybrać?

System plików i sposób budowy macierzy wpływają na bezpieczeństwo i wygodę administracji.

- mdraid + ext4/xfs – klasyczne rozwiązanie w Linuksie. Stabilne, znane, wspierane przez większość dystrybucji i narzędzi. Wymaga dodatkowych narzędzi do snapshotów i replikacji.

- Btrfs – oferuje snapshoty, sumy kontrolne i pewne funkcje „copy-on-write”. W NAS-ach (Synology, część QNAP) bywa używany jako system plików domyślny. Wciąż ma kilka ograniczeń przy skomplikowanych macierzach, ale do prostych układów z mirrorami jest wygodny.

- ZFS – rozbudowany system plików z integracją RAID, sumami kontrolnymi, snapshotami, replikacją i kompresją. Świetnie nadaje się na duży magazyn danych, choć wymaga sensownej ilości RAM i pewnej dyscypliny przy konfiguracji.

Dla osoby, która chce mieć kontrolę i jednocześnie uprościć sobie zarządzanie, ZFS w połączeniu z Proxmoxem lub TrueNAS staje się naturalnym kandydatem. Dla prostego serwera na Debianie wystarczy często mdraid + ext4.

Jak nie zabić dysków: wibracje, temperatura, zasilanie

Nowe dyski potrafią się zepsuć, ale częściej problemy pojawiają się przy złych warunkach pracy. Trzy proste obszary kontroli:

- temperatura – HDD lubią okolice 30–40°C w spoczynku. Stałe 50–55°C skraca ich życie. Przy małej obudowie jeden cichy wentylator 120 mm skierowany na koszyk z dyskami bywa lepszy niż dwa małe „wyjce”.

- wibracje – luźno skręcone dyski w taniej obudowie rezonują i hałasują, a w skrajnym przypadku powodują błędy odczytu. Dobrze skręcona rama na dyski i gumowe podkładki mechanicznie uspokajają całość.

- zasilanie – tanie zasilacze bez zabezpieczeń potrafią przy zwarciu uszkodzić nie tylko dysk, ale i płytę główną. Jeden markowy PSU zwykle oszczędza nerwy przy pierwszym poważniejszym zwarciu.

Strategia backupu: lokalnie, zewnętrznie, w chmurze

Warstwy kopii: od „tu i teraz” do scenariusza pożaru

Bezpieczny backup nie opiera się na jednym mechanizmie. Praktyka pokazuje, że sens ma układ warstwowy:

- lokalne snapshoty – szybkie cofnięcie się o godzinę lub dzień przy przypadkowym skasowaniu lub aktualizacji, która coś popsuła

- druga kopia w domu – drugi dysk, inny komputer, stara obudowa USB; ochrona przed awarią macierzy lub błędem użytkownika

- kopia poza domem – chmura, dysk u znajomego, drugi serwer w pracy; scenariusz pożaru, zalania, kradzieży

Krótkie pytanie kontrolne: czy utrata danych boli bardziej niż koszt dodatkowego dysku lub kilkunastu złotych miesięcznie na chmurę? Jeśli odpowiedź brzmi „tak”, to budżet backupowy staje się osobną pozycją, a nie resztką po zakupie GPU.

Kopie offline i „air-gap” w realiach zwykłego mieszkania

W domowych warunkach kopia offline zazwyczaj oznacza po prostu dysk, który większość czasu jest odłączony. W praktyce może to być:

- dysk USB 3.5″ wpięty raz w tygodniu, z automatycznym rsync/Restic/Borg

- stary laptop z zaszyfrowanym dyskiem, który po backupie jest wyłączany i chowany do szuflady

Takie rozwiązanie nie jest eleganckie, ale ma jedną, bardzo konkretną zaletę: ransomware z domowych komputerów nie zaszyfruje nośnika, który akurat leży w szafie. Minusem staje się dyscyplina – jeżeli kopia offline jest robiona raz na pół roku, jej użyteczność spada do poziomu archiwum, a nie realnej ochrony.

Chmura: ile danych opłaca się wynieść z domu

Chmura domyka układ backupowy, szczególnie dla danych o najwyższej wartości emocjonalnej lub prawnej. Dla większości rodzin są to:

- zdjęcia i filmy rodzinne

- skany dokumentów i ważne pliki tekstowe

Wiele rozwiązań (Backblaze B2, Wasabi, Object Storage od operatorów) rozlicza się z faktycznie użytej przestrzeni. Ciężkie multimedia 4K z serwera multimediów często taniej i rozsądniej trzymać lokalnie, a do chmury wysyłać tylko foldery „nie do odtworzenia”. Dodatkiem mogą być zaszyfrowane snapshoty z ZFS wysyłane okresowo w nocy.

Kluczowe zasady rotacji i testu przywracania

Część awarii pokazuje jedno: kopia, której nie da się przywrócić, jest złudzeniem bezpieczeństwa. Kilka praktycznych reguł:

- raz na kilka miesięcy można odtworzyć losowy plik lub katalog na inne urządzenie – prosty test, czy backup faktycznie działa

- przy rotacji dysków dobrze oznaczyć je fizycznie (data, rola, ostatnie użycie); kartka i marker rozwiązują późniejsze wątpliwości

- konfiguracje usług (docker-compose, pliki .yaml, skrypty) warto zrzucać do repozytorium Git z kopią w chmurze – odtworzenie usług bywa ważniejsze niż samych danych

Obudowa, zasilacz, chłodzenie – czyli dlaczego serwer nie może brzmieć jak odkurzacz

Obudowa: liczba zatok, przepływ powietrza i miejsce na biurku

Domowy serwer częściej ląduje w salonie lub sypialni niż w osobnym pomieszczeniu technicznym. To zmienia priorytety: głośność i rozmiar zaczynają mieć podobną wagę jak pojemność.

Przy wyborze obudowy liczą się trzy konstruktywne parametry:

- liczba i orientacja zatok 3.5″ – minimum 2–4 miejsca, najlepiej w koszyku z bezpośrednim nawiewem

- obsługiwany format płyty głównej – mini-ITX, mATX lub ATX; mniejsze formaty ułatwiają ukrycie serwera

- rozmiar wentylatorów – 120/140 mm dają tę samą ilość powietrza przy niższych obrotach niż 80 mm

Często używanym kompromisem jest budżetowa obudowa mATX z miejscem na cztery dyski i dwoma wolnymi miejscami na wentylatory 120 mm. Nie wygląda jak klasyczny serwer, ale zapewnia przyzwoity przepływ powietrza i wystarczającą rozbudowę na kilka lat.

Markowy zasilacz czy „coś z szuflady”

Zasilacz w serwerze domowym nie jest tylko źródłem napięcia, lecz także filtrem zakłóceń i zabezpieczeniem przed skutkami zwarcia. Z faktów:

Jeśli interesują Cię konkrety i przykłady, rzuć okiem na: Jak skonfigurować lekki system dla ucznia?.

- sprzęt w trybie 24/7 pracuje często przy obciążeniu 40–80 W, czyli bardzo daleko od maksimum mocy PSU

- tanie, przewymiarowane jednostki 600–700 W mają kiepską sprawność w niskim obciążeniu

Dlatego rozsądniej sprawdza się zasilacz 300–450 W z certyfikatem 80+ Bronze lub Gold, od zaufanego producenta, z długą gwarancją. Taki PSU będzie pracował w optymalnym zakresie, mniej się nagrzewał, a przy okazji często ma lepszą kulturę pracy wentylatora.

Chłodzenie CPU i dysków: jak zejść z hałasem przy zachowaniu zapasu

Zbyt agresywne chłodzenie potrafi zniszczyć domowy charakter serwera. Rozwiązanie jest techniczne, a nie magiczne:

- prosty, większy cooler wieżowy na CPU (lub rozbudowany box z dużym wentylatorem) i dobrze ustawiona krzywa obrotów

- przynajmniej jeden wentylator zasysający powietrze na wysokości dysków 3.5″ oraz jeden wyciągowy z tyłu obudowy

Przy poprawnym przepływie powietrza często udaje się zejść do niskich obrotów rzędu kilkuset rpm, które stają się praktycznie niesłyszalne z kilku metrów. W praktyce bardziej dają o sobie znać wibracje talerzy HDD niż sam szum powietrza – gumowe podkładki i solidne mocowanie pomagają wyciszyć całość.

Umiejscowienie serwera w mieszkaniu

Nawet najcichszy serwer umieszczony na biurku w sypialni potrafi irytować w nocy. Z perspektywy użytkownika wygodna bywa lokalizacja:

- w szafce RTV lub zamkniętej niszy, ale z pozostawioną przestrzenią za sprzętem dla wyrzutu ciepłego powietrza

- w korytarzu lub schowku, gdzie hałas mniej przeszkadza, a dostęp do okablowania jest nadal łatwy

Przy przenoszeniu urządzenia dalej od routera zwykle kończy się to dołożeniem dłuższych przewodów Ethernet lub użyciem kolejnego punktu sieciowego. Sumarycznie jest to mniejszy kłopot niż ciągłe słuchanie odgłosów talerzy w salonie.

System operacyjny i oprogramowanie – Proxmox, TrueNAS, Debian, czy może Windows?

Co wiemy o profilach użytkowników domowych

Domowe serwery obsługują co najmniej trzy typy użytkowników:

- osoby chcące prostego NAS-a z kilkoma usługami (multimedia, kopia zdjęć)

- osoby zainteresowane wirtualizacją i kontenerami

- eksperymentujących z AI, potrzebujących bibliotek CUDA/ROCm i dostępu do GPU

Wybór systemu wpływa na wygodę konfiguracji tych scenariuszy. Kluczowe pytanie brzmi: ile czasu jesteś w stanie poświęcić na naukę i ręczne poprawki, a ile wolisz oddać w „ręce” gotowego interfejsu?

TrueNAS: specjalista od storage’u

TrueNAS (CORE lub SCALE) jest zbudowany wokół ZFS i funkcji serwera plików. Mocne strony:

- wygodny interfejs WWW do zarządzania macierzami, snapshotami i replikacją

- dobre wsparcie SMB/NFS/iSCSI i mechanizmów typu Time Machine

- gotowe „aplikacje” i kontenery z popularnymi usługami (Nextcloud, Plex, itp.)

Słabszą stroną bywa elastyczność w bardziej niestandardowych scenariuszach, szczególnie przy pracy z GPU do AI. TrueNAS SCALE na Linuksie daje tu więcej możliwości niż wersja bazująca na FreeBSD, ale nadal jest to system, w którym priorytetem jest storage, a nie eksperymenty z frameworkami ML.

Proxmox VE: wirtualizator jako baza „wszystkiego”

Proxmox łączy KVM (maszyny wirtualne), LXC (kontenery), ZFS i rozbudowany panel WWW. W praktyce pozwala:

- utrzymać osobne VM na potrzeby testów, usług domowych i eksperymentów z AI

- odseparować system „bazowy” od wnętrza usług – łatwiej coś zepsuć w jednej VM niż na całym serwerze

- korzystać z klastrów i replikacji, jeśli kiedyś serwerów przybędzie

Przy pojedynczej maszynie w domu Proxmox może wydawać się rozbudowany, ale dla kogoś, kto lubi porządek i możliwość szybkiego snapshotu całej VM przed większym eksperymentem, jest to wygodna baza. Konfiguracja dostępu do GPU dla VM i kontenerów wymaga kilku kroków więcej niż w „gołym” Linuksie, lecz w zamian zyskuje się szkielety pod bardziej zaawansowane układy.

Debian/Ubuntu Server: klasyczny Linux pod Dockera i narzędzia AI

Na drugim biegunie leży zwykła dystrybucja Linuksa z ręcznie instalowanymi usługami. Typowy układ:

- Debian lub Ubuntu Server jako minimalna baza

- Docker / Podman do trzymania większości aplikacji jako kontenerów

- narzędzia ML (PyTorch, TensorFlow, biblioteki do LLM) instalowane bezpośrednio lub w dedykowanych kontenerach

Taki model daje dużą elastyczność, ale przenosi odpowiedzialność za aktualizacje, kopie konfiguracji i monitoring na użytkownika. W zamian zapewnia prostszy dostęp do GPU i najnowszych bibliotek, co przy zabawie z modelami generatywnymi bywa rozstrzygające.

Windows: kiedy to ma sens na serwerze domowym

Windows w roli serwera spotyka się rzadziej, ale nie znika z rynku domowego. Ma kilka specyficznych atutów:

- obsługa oprogramowania, które nie ma wersji linuksowej (niektóre gry, aplikacje multimedialne)

- łatwiejsza konfiguracja dla osób przyzwyczajonych do interfejsu graficznego

- komfortowe wsparcie dla sterowników GPU i narzędzi do AI skierowanych głównie na Windows

Z drugiej strony system ten gorzej integruje się z mechanizmami ZFS/Btrfs, a automatyzacja zadań backupowych zwykle wymaga osobnych narzędzi lub skryptów PowerShell. Rozsądnym kompromisem bywa scenariusz, w którym Windows funkcjonuje jako maszyna robocza z GPU, a dane trzymane są na linuksowym NAS-ie.

Kontenery i orkiestracja: jak nie utonąć w rosnącej liczbie usług

Wraz z rozbudową serwera pojawia się naturalny problem: kilkanaście aplikacji, każda z własnymi zależnościami. Kontenery rozwiązują to na dwa sposoby:

- izolują środowiska (różne wersje Pythona, baz danych, bibliotek)

- upraszczają aktualizacje – nowa wersja obrazu zamiast ręcznej przebudowy systemu

W domowym środowisku często wystarcza Docker Compose lub Portainer jako prosty panel do kontroli kontenerów. Kubernetesa raczej nie potrzeba – narzut administracyjny przewyższa zyski przy jednym, dwóch serwerach. Przy AI kontenery pozwalają także separować różne wersje sterowników CUDA i bibliotek ML, co zmniejsza ryzyko konfliktów.

Automatyzacja zadań i monitorowanie: elementy, o których łatwo zapomnieć

Serwer, który robi coś sam z siebie, a nie tylko czeka na ręczne polecenia, lepiej spełnia swoją rolę. Kilka przykładów automatyzacji:

- cykliczne zadania cron/systemd do wykonywania backupów, sprawdzania integralności ZFS/Btrfs, porządkowania logów

- skrypty wybudzające drugą maszynę (Wake on LAN) na czas obliczeń AI i usypiające ją po zakończeniu pracy

- powiadomienia e-mail/Matrix/Telegram przy awarii dysku, przegrzewaniu lub braku miejsca

Do monitorowania zasobów dobrze sprawdza się prosty stack typu Prometheus + Grafana lub lżejsze narzędzia (Netdata, Zabbix w podstawowej konfiguracji). Dzięki temu szybciej widać, czy serwer zaczyna „dławić się” RAM-em, dyskiem lub procesorem, zamiast zgadywać po subiektywnych odczuciach.

Najczęściej zadawane pytania (FAQ)

Jaki sprzęt wystarczy na tani domowy serwer do backupu i multimediów?

Do samego backupu i prostego udostępniania plików wystarczy energooszczędny procesor 2–4 rdzeniowy (np. starszy i3, Pentium Gold, Ryzen 3/5 serii U), 4–8 GB RAM i 1–2 dyski HDD 4–8 TB. System można postawić na małym SSD (np. 120–240 GB), a dane trzymać na talerzowych dyskach.

Jeśli dochodzi serwer multimediów (Jellyfin, Plex) i możliwe transkodowanie filmów, sensownym minimum jest 4–6 rdzeniowy CPU, 8–16 GB RAM i konfiguracja: SSD na system + HDD na dane. Przy TV obsługującym „z pudełka” większość kodeków, obciążenie CPU będzie niskie, więc nie ma potrzeby inwestować w bardzo mocny procesor.

Czy domowy serwer opłaca się bardziej niż chmura albo gotowy NAS?

Serwer w domu zwykle zaczyna być opłacalny, gdy przechowujesz kilka–kilkanaście terabajtów danych i płacenie za taki wolumen w chmurze staje się wyraźnie droższe niż koszt prądu i amortyzacji sprzętu. Dodatkowy argument to pełna kontrola nad danymi: brak zewnętrznego dostawcy, łatwiejsze spełnienie wymogów prywatności czy RODO.

Chmura z kolei wygrywa, gdy masz tylko kilka–kilkanaście gigabajtów zdjęć i dokumentów oraz nie chcesz zajmować się administracją. Gotowy NAS (Synology, QNAP) jest rozwiązaniem pośrodku: prostszy w obsłudze niż „składany” serwer, ale mniej elastyczny, szczególnie pod cięższe zastosowania jak eksperymenty z AI czy rozbudowana wirtualizacja.

Ile prądu zużywa domowy serwer i jak to ograniczyć?

Kluczowe jest zużycie energii w spoczynku, bo serwer zwykle pracuje 24/7. Różnica 20–30 W w idle przekłada się w skali roku na zauważalny koszt na rachunku. Mini PC lub terminale thin client z laptopowymi CPU potrafią zejść w spoczynku do kilkunastu watów, podczas gdy stary desktop z mocnym zasilaczem i kartą graficzną potrafi zużywać wielokrotnie więcej.

Zużycie można ograniczyć przez wybór energooszczędnego CPU, małego zasilacza o wysokiej sprawności, redukcję liczby HDD (lub usypianie mniej używanych dysków) oraz wyłączanie zbędnych usług. Praktyczne pytanie kontrolne brzmi: ile godzin dziennie serwer faktycznie „coś robi”, a ile tylko czuwa?

Jak mocne GPU jest potrzebne do domowych eksperymentów z AI?

Do pierwszych eksperymentów z lokalnymi modelami językowymi (LLaMA, Mistral, Qwen w wersjach skompresowanych) i prostych zadań można obyć się bez dedykowanego GPU – wystarczy sensowny 6–8 rdzeniowy CPU i 16 GB RAM. Wiele narzędzi AI ma tryby zoptymalizowane pod CPU i działa znośnie na „domowym” sprzęcie.

Dedykowane GPU z 6–12 GB VRAM zaczyna być potrzebne przy większych modelach, intensywnej pracy ze Stable Diffusion albo jednoczesnym uruchamianiu kilku „cięższych” zadań. Trzeba jednak odpowiedzieć sobie na pytanie: czy to będzie praca codzienna, czy kilka godzin w miesiącu? Zbyt mocne GPU może większość czasu stać bezczynnie, generując tylko wyższe zużycie energii w trybie jałowym.

Czy stary komputer nadaje się na domowy serwer 24/7?

Stary desktop często jest dobrym sprzętem testowym „na start”, ale rzadko sprawdza się w długim biegu jako tani i cichy serwer domowy. Typowe problemy to wysoki pobór prądu w spoczynku, głośne wentylatory, duża obudowa i brak nowoczesnych funkcji oszczędzania energii. Przy całodobowej pracy różnice w rachunku za prąd w skali roku potrafią zjeść oszczędność na zakupie.

Jeśli taki komputer już masz, możesz go wykorzystać do sprawdzenia, czy scenariusz domowego serwera w ogóle ma sens dla Twojej rodziny. Gdy upewnisz się, że faktycznie korzystasz z usług (backup, multimedia, kontenery), zwykle opłaca się przejść na bardziej energooszczędną i kompaktową platformę.

Co wybrać na start: mini PC, terminal thin client czy gotowy NAS?

Mini PC i terminale thin client są dobrym kompromisem między ceną, poborem prądu a elastycznością. Zajmują mało miejsca, można je schować za telewizor lub do szafki, a jednocześnie pozwalają na instalację pełnego systemu (np. Linux, Proxmox) i uruchamianie kontenerów czy prostych eksperymentów z AI. Ograniczeniem bywa liczba zatok na dyski i możliwości rozbudowy.

Gotowy NAS sprawdza się tam, gdzie priorytetem jest prostota i niezawodność podstawowych usług: backup, udostępnianie plików, multimedia. Jego interfejs i aplikacje są skierowane do mniej technicznych użytkowników. Jeśli planujesz rozbudowane laboratorium z wieloma kontenerami, wirtualizacją i AI, własny serwer na bazie PC lub mini PC daje większą swobodę konfiguracji.

Kluczowe Wnioski

- O sensie budowy domowego serwera decydują realne, powtarzalne potrzeby (backup, multimedia, lekkie usługi, eksperymenty z AI), a nie jednorazowe zachcianki czy „na wszelki wypadek”.

- Dla samego backupu zdjęć, dokumentów i konfiguracji wystarczy bardzo skromna, energooszczędna konfiguracja z kilkoma dużymi HDD – kluczowy jest dobrze przemyślany schemat kopii, a nie moc procesora.

- Przy serwerze multimediów wymagania sprzętowe mocno zależą od transkodowania: jeśli urządzenia klienckie odtwarzają pliki natywnie, CPU może być słaby; masowe transkodowanie filmów Full HD/4K wymaga znacznie wydajniejszej jednostki.

- Eksperymenty z AI nie zawsze oznaczają konieczność kupowania drogiego GPU – wiele skompresowanych modeli LLM i prostszych zadań (OCR, detekcja) działa akceptowalnie na samym CPU z ok. 16 GB RAM, a przewymiarowana karta graficzna często większość czasu tylko zużywa prąd w spoczynku.

- Wybór między domowym serwerem, chmurą i gotowym NAS-em zależy od skali danych, wymaganego poziomu kontroli oraz czasu na administrację: dużo danych i chęć majsterkowania sprzyjają własnemu serwerowi, małe zbiory i brak czasu – chmurze, a NAS jest kompromisem dla rodzin.

- Największym ograniczeniem domowego serwera działającego 24/7 jest pobór mocy w idle, a zaraz potem hałas i miejsce; mini PC i thin clienty często wygrywają, bo można je schować za TV, są ciche i pobierają mało prądu.